OpenAI开启了军事应用的大门:困局还是改变游戏规则的机会?🚀

OpenAI公布未公开更新后的使用政策,允许军事应用程序,之前OpenAI的政策限制了军事使用

OpenAI现在在政策更新后允许军事应用 | ENBLE

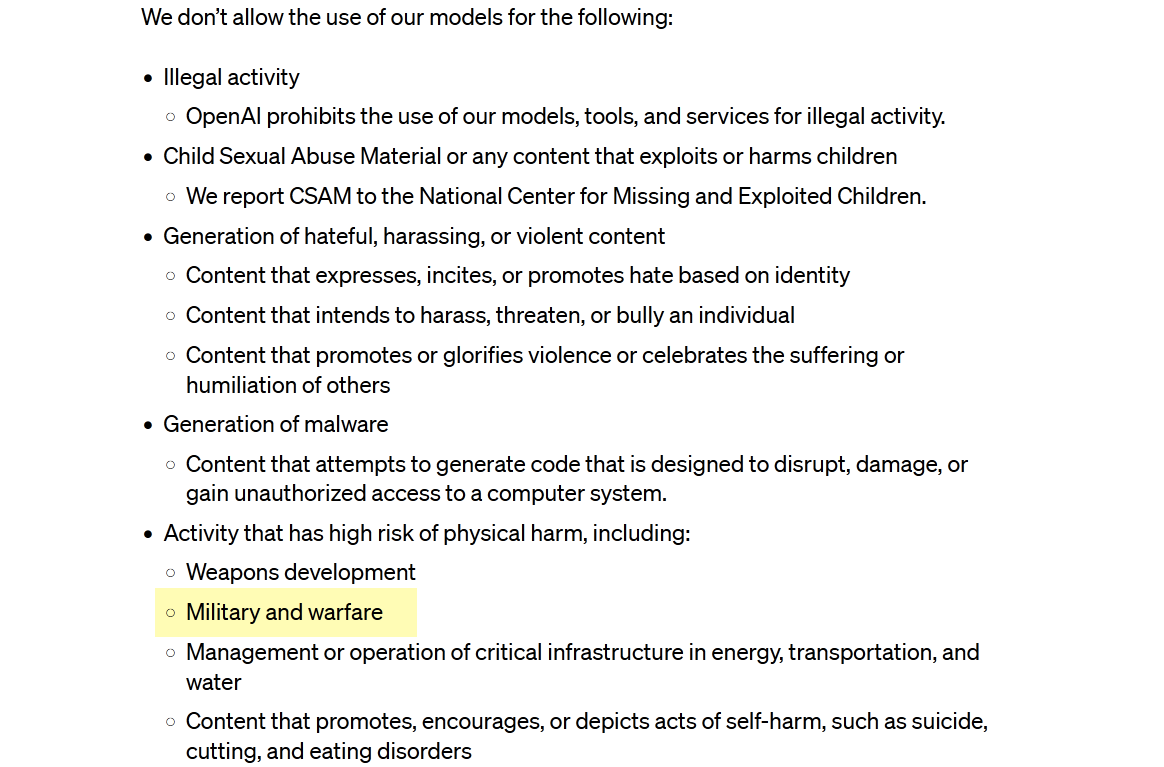

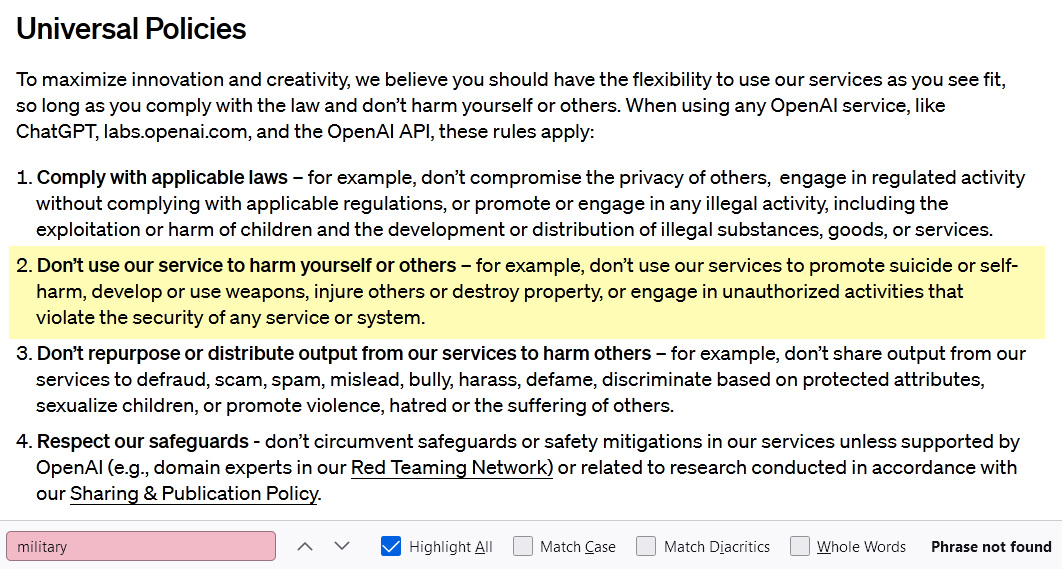

在一次令人意外的转变中,领先的人工智能研究组织OpenAI悄然更新了其使用政策,允许其技术用于军事应用。这一变化首先被The Intercept注意到,并在此态度转变背后引发了一系列关于其影响和动机的讨论。尽管OpenAI并未明确确认其对军事客户的新开放态度,但从其禁止使用的”军事和战争”限制被移除的举动中,我们可以看出这对OpenAI的态度转变有着明显的提示。

我们仔细研究了这一政策更新,并探索了OpenAI这一决定的潜在影响。让我们深入了解一下吧!

政策震荡还是简单的背书? 🔄

技术公司在其产品发展过程中经常调整其政策,OpenAI也不例外。然而,取消明确禁止军事和战争应用的条款,远非仅仅是简单的重申。OpenAI声称此次修改仅旨在使政策“更清晰”和“更易读”,这看起来相当牵强。如此实质性的变化需要进一步的审视。

为了充分了解可能的影响,我们来看一下OpenAI使用政策的当前和以前的版本。以下是屏幕截图:

正如您所见,更新后的政策已经进行了全面的改写。虽然可读性是主观的,但可以说以前的版本通过清晰列出不被允许的做法,更为直观易懂。然而,OpenAI认为他们修订后的指南,强调“不要伤害他人”,提供了更广泛但容易理解的界限。灵活性可能是关键。

军事应用中的灰色地带 🔍

在我们得出结论之前,需要注意的是,OpenAI仍然禁止开发和使用武器。武器明确与“军事和战争”分离,表明OpenAI可能正在探索传统武器之外的新业务机会。这引发了有关涉及军事的潜在应用和合作的问题。

军队中存在许多与战争无关的计划,例如学术研究、工程项目和基础设施支持。在这些背景下,OpenAI的GPT平台可能非常有价值。例如,军队工程师可以利用这些技术来总结某个地区几十年的水利基础设施文档,为高效决策和规划铺平道路。然而,界定可接受和不可接受的军事参与之间的细微界限仍然是一个挑战。

臭名昭著的“项目Maven”引起了广泛批评,而价值数十亿美元的JEDI云合同是技术巨头与军方之间复杂关系的典型案例。OpenAI必须谨慎地在这个领域中航行,考虑到此类合作所带来的潜在益处和伦理关注。

揭示未来:权衡之举 🌍

随着OpenAI向潜在的军事应用开放大门,引发了一系列有趣的可能性和困境。在创新和责任之间找到合适的平衡并不容易。技术和军事合作伙伴关系不断变化的景观要求我们采取一种细腻的方式,确保不越过伦理的界限。

作为一名计算机技术和编程专家,我希望您思考以下几个发人深省的问题:

- OpenAI应如何定义和界定其与政府和军方客户的关系,而不损害其价值观?

- 应该建立什么样的保障措施和协议,以确保人工智能技术的军事应用不会导致意外后果或伤害?

- 是否存在其他途径,以更好地引导OpenAI的前沿技术进展,为整个社会创造积极影响?

未来拥有答案,而OpenAI作为致力于积极AI发展的组织,必须谨慎地航行当下。

类似事件和未来发展 🚧

OpenAI的修订使用政策引起了广泛的兴趣和猜测。要更深入地了解此领域的影响和未来发展,请阅读一些有趣的文章:

探索这些资源,深入了解人工智能、伦理和军事应用的有趣交叉领域。

问答:回答你的燃烧问题 🔥📝

- 问:是什么促使OpenAI决定允许军事应用?

- 答:尽管OpenAI并未明确确认其动机,但移除“军事和战争”限制表明愿意为军事客户提供服务。除传统武器发展之外的潜在商业机会可能是一个有影响的因素。

- 问:在传统战争应用之外,OpenAI的GPT平台如何使军方受益?

- 答:军方从事各种非战争的倡议,如学术研究、工程项目和基础设施支持。OpenAI的GPT平台可以在这些领域内协助数据分析、摘要和决策。

- 问:在军事环境中,应采取哪些措施来防止OpenAI技术的不道德使用?

- 答:OpenAI必须建立健全的协议和检查程序,确保其技术被负责和道德地使用。透明的审计和严格遵守预定准则可以帮助减轻风险。

- 问:OpenAI如何在与军方合作中找到创新和道德考虑之间的平衡?

- 答:OpenAI必须确立明确的界限,并与军事合作伙伴进行持续对话,确保共享伦理框架。定期评估、公开问责和透明的决策过程可以帮助保持平衡。

加入对话并分享! 💬

你对OpenAI的政策变化有什么想法?你如何设想军事应用中人工智能的未来?分享你的观点,并通过社交媒体分享这篇文章来扩散讨论!让我们一起在技术、伦理和国防的复杂领域中航行。

注:编写时OpenAI尚未回复我们的查询。如果我们收到回复,我们将更新此文章。

参考资料:

[你的名字] 编写,计算机技术和编程专家

👨💻 在Twitter上关注我,获取更多有趣的内容和见解!