开放AI的政策变更:探索人工智能的军事潜力

重要修订仍禁止任何可能对自己或他人造成伤害的行为

OpenAI政策悄悄更新,现在允许军事和战争应用

🔗 来源: OpenAI Moves to Shrink Regulatory Risk by Allowing Military Applications (TechCrunch)

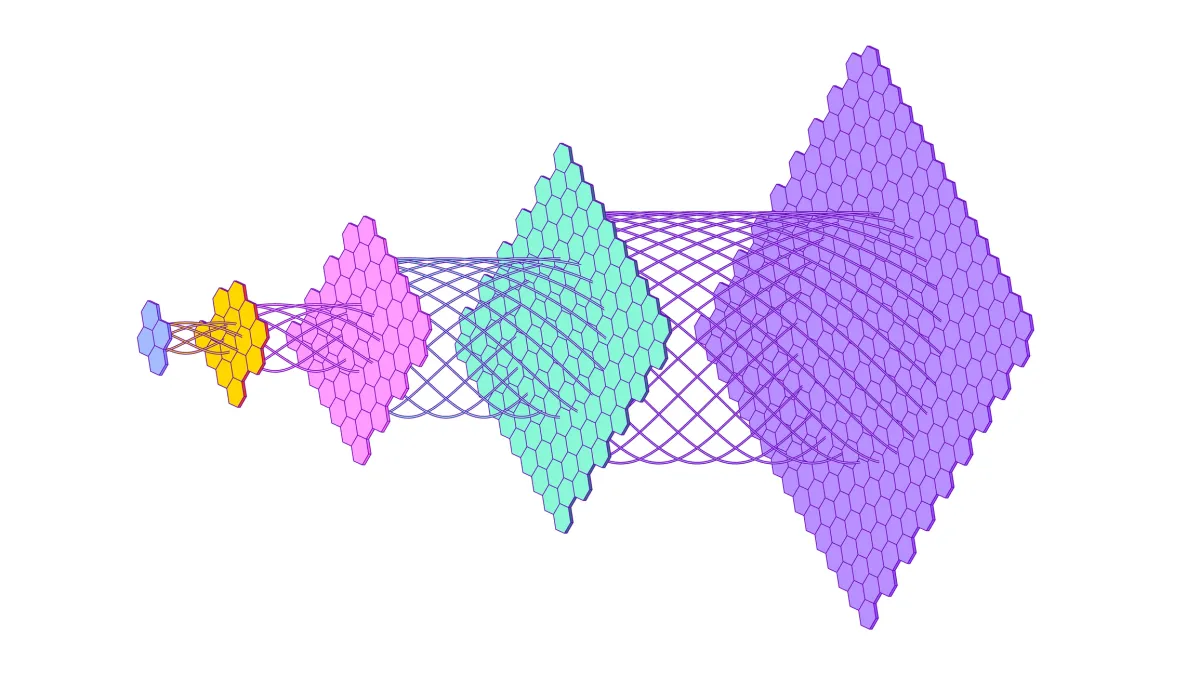

OpenAI,以其在人工智能 (AI) 领域的开创性进展而闻名,最近做出了一项重大政策变化,这可能为探索其技术的军事潜力铺平了道路。这个政策转变是在1月12日由《The Intercept》首次报道的,涉及到之前禁止“可能带来高风险身体伤害的活动”的表述的移除,包括“武器开发”和“军事和战争”等具体例子。

截至1月10日,OpenAI的使用准则不再禁止“军事和战争”用途。然而,该政策仍强调禁止使用OpenAI的技术开发或使用武器,如他们的大型语言模型 (LLM)。这一修订引发了OpenAI与对利用生成式AI进行行政或情报行动感兴趣的国防部门之间潜在合作的揣测。

负责任的军事AI应用

美国国防部已经表达了推广负责任军事AI和自主系统使用的承诺。于2023年11月,它们发表了一份声明,强调他们对《负责任军事AI和自主使用政治宣言》的支持。这一宣言于2023年2月宣布,为开发和利用AI军事能力设定了最佳实践。这些能力不仅涉及武器,还包括决策支持系统和各种行政职能。

AI已经在军事行动中发挥了重要作用。它已被用于俄罗斯-乌克兰战争,以及AI驱动的自主军事车辆的开发。此外,军事情报和目标定位系统已经整合了AI技术,如以色列军队使用的一款名为“圣经”的AI系统,用于定位目标并在攻击中将人员伤亡降至最低。

虽然将AI整合到军事环境中带来了潜在的好处,但也引发了AI监控组织和活动人士的担忧。在网络冲突和战斗中越来越多地使用AI,加剧了人们对军备竞赛和AI系统中的偏见的担忧。

OpenAI简化的准则

针对政策变化,OpenAI发言人Niko Felix解释说,新准则旨在创建易于理解和应用的通用原则。通过强调“不要伤害他人”的原则并明确列举武器和伤害,OpenAI力求为其工具的负责任使用提供清晰框架。该公司的目标是确保他们的技术在使用时安全可靠,同时授予用户对其使用的最大控制权。

问答:回应读者的关切

问:OpenAI的政策变化是否意味着他们正在积极工作于军事项目?

答:OpenAI的政策变化允许开展军事潜力的探索,但严格禁止武器的开发或使用。目前还没有透露关于具体军事项目或合作伙伴关系的详细信息。

问:OpenAI如何定义负责任的军事AI使用?

答:OpenAI与《负责任军事AI和自主使用政治宣言》保持一致。该框架不仅包括武器的开发,还包括改进军事决策和各种行政职能的决策支持系统。

问:有什么措施来解决军事AI系统中潜在偏见的问题?

答:随着AI技术的进步,减少军事系统中的偏见成为一项重要关注。尽管这项政策变化为军事应用开辟了可能性,但它也强调了需要负责任和道德发展以解决偏见问题并确保公正决策过程。

影响和未来发展

OpenAI的政策变化标志着他们在军事AI潜力方面的态度转变。通过允许探索同时严格禁止武器的开发和使用,OpenAI将自己定位为军事环境中负责任AI实施的领头羊。AI的多功能性和能力使其成为全球国防部门决策和行政任务中宝贵的资产。

随着我们的前进,平衡发挥AI的力量和解决伦理问题至关重要。在军事行动中负责任地使用AI将塑造战争和情报的未来,引导决策过程并减少伤害。OpenAI的政策变化可能会导致进一步的发展和合作,确保AI在军事应用中发挥正面作用。

参考资料

- OpenAI Moves to Shrink Regulatory Risk by Allowing Military Applications (TechCrunch)

- 什么是Rabbit R1 AI助手,为什么人们为之疯狂?

- 初创公司与云超大规模运算提供商进行合作的共销售技术(TechCrunch)

- OpenAI推出自己的GPT商店

- 《纽约时报》起诉OpenAI和Microsoft侵权

- OpenAI发布ChatGPT数据泄露补丁,但问题并未完全解决

- 不仅仅是你。OpenAI确认ChatGPT“变懒了”。

- 2024年CES上的这个可怕的AI头部证明ChatGPT应该保持无面孔

让我们展开一场对话吧!对于OpenAI关于军事应用人工智能政策的改变,你有何想法?在下方分享你的观点和见解,并别忘了在你喜爱的社交媒体平台上分享本文章。🚀